はじめに

あなたが今日使った「あの機能」の裏側に、ある技術が隠れています。

Google Meetで背景をぼかしたとき。iPhoneのポートレートモードで人物にピントが合い、背景がきれいにボケたとき。Zoomで自分の部屋の代わりにバーチャル背景を表示したとき。あるいは、ECサイトで商品画像の背景が白く切り抜かれていたとき。

これらはすべて、セマンティックセグメンテーションと呼ばれる同じ種類の技術で実現されています。

名前を聞いたことがない方がほとんどでしょう。しかし、この技術は今、AIエージェント時代を迎えた私たちのビジネスと暮らしを、静かに、しかし根本的に変えようとしています。

本連載では全4回にわたって、セマンティックセグメンテーションの基礎から最前線、そしてAIエージェントがWebサイトを「見て」「理解して」「操作する」時代への展望までを解説していきます。

第1回の今回は、まず「セマンティックセグメンテーションとは何か」を、身近な体験から紐解きます。

Google Meetの裏側で起きていること

Google Meetで「背景をぼかす」ボタンを押したとき、画面の裏側では何が起きているのでしょうか。

答えは、「映像のすべてのピクセルを、1つ残らず、"人"か"背景"かに分類している」です。

Google Meetは、MediaPipeというGoogleの機械学習フレームワークを使って、毎秒最大30フレームの映像を処理しています。各フレームに対してMLモデルが推論を実行し、低解像度のセグメンテーションマスク(どのピクセルが人物で、どのピクセルが背景かを示すマップ)を生成します。そのマスクを元に、背景部分だけにぼかし処理(ボケ効果)をかけ、人物部分はそのまま表示する。これが「背景ぼかし」の仕組みです。

驚くべきは、この処理がすべてブラウザの中で、追加のソフトウェアなしに行われていることです。Googleの研究チームは、WebAssemblyとXNNPACKライブラリを活用してCPU上でのリアルタイム推論を実現しました。さらに中・高スペックのデバイスでは、WebGLのフラグメントシェーダを使ってGPU推論にも対応し、より高精細なセグメンテーションを行っています。

ここで重要なのは、背景ぼかしにおける「人か背景か」の判定が、色や明るさだけでは決まらないということです。たとえば白いシャツを着た人が白い壁の前に立っている場合、色だけを頼りにしたら人物と背景の境界を判別できません。機械学習モデルは膨大な学習データから「人の形」の特徴を学んでおり、色に関係なく「ここは人の輪郭だ」と判断できます。

つまり、ピクセルの「色」ではなく「意味」で分類している。だからこそ「セマンティック(意味的)」セグメンテーションと呼ばれるのです。

あなたのiPhoneもやっている

Google Meetだけではありません。iPhoneのカメラもまた、セマンティックセグメンテーションの塊です。

AppleはiOS 12で、ポートレートモード用の「Portrait Effect Matte」(人物全身のセグメンテーション)を導入しました。さらに2019年のWWDC(開発者向けカンファレンス)では、iOS 13の新機能として「セマンティックセグメンテーションマット」を発表。Apple Neural Engine(機械学習専用のプロセッサ)を使って、人物の「髪」「肌」「歯」をそれぞれピクセル単位で分離できるようになりました。

こうしたセグメンテーション情報は、iPhoneのカメラ機能全体に活用されています:

- ポートレートモード: 人物と背景を分離し、背景に擬似的なボケ効果を適用

- ポートレートライティング: 人物の輪郭に基づいて照明効果(ステージライト、ハイキーモノ等)を合成

- Smart HDR: 人物・肌・空をそれぞれ認識し、コントラストや色調を個別に最適化

- フォトグラフスタイル: セグメンテーションマスクで「肌」「空」「植物」を区別し、肌色を保ちながらスタイルを適用

注目すべきは、これらがすべてデバイス上で完結していることです。写真がクラウドに送信されることはなく、Neural Engine上で数ミリ秒のうちに処理されます。Appleの研究チームが公開したApple Neural Scene Analyzer(ANSA)の事例では、MobileNetV3ベースの16百万パラメータのモデルが、iPhone 13上で全タスクを9.7ミリ秒以内に実行し、メモリ使用量は約24.6MBに抑えられています。

スマートフォン1台の中に、数年前なら研究室レベルの計算資源を必要としたセマンティックセグメンテーションが、すでに日常の道具として組み込まれているのです。

そもそも「セマンティックセグメンテーション」とは何か

ここで改めて、技術の全体像を整理しましょう。

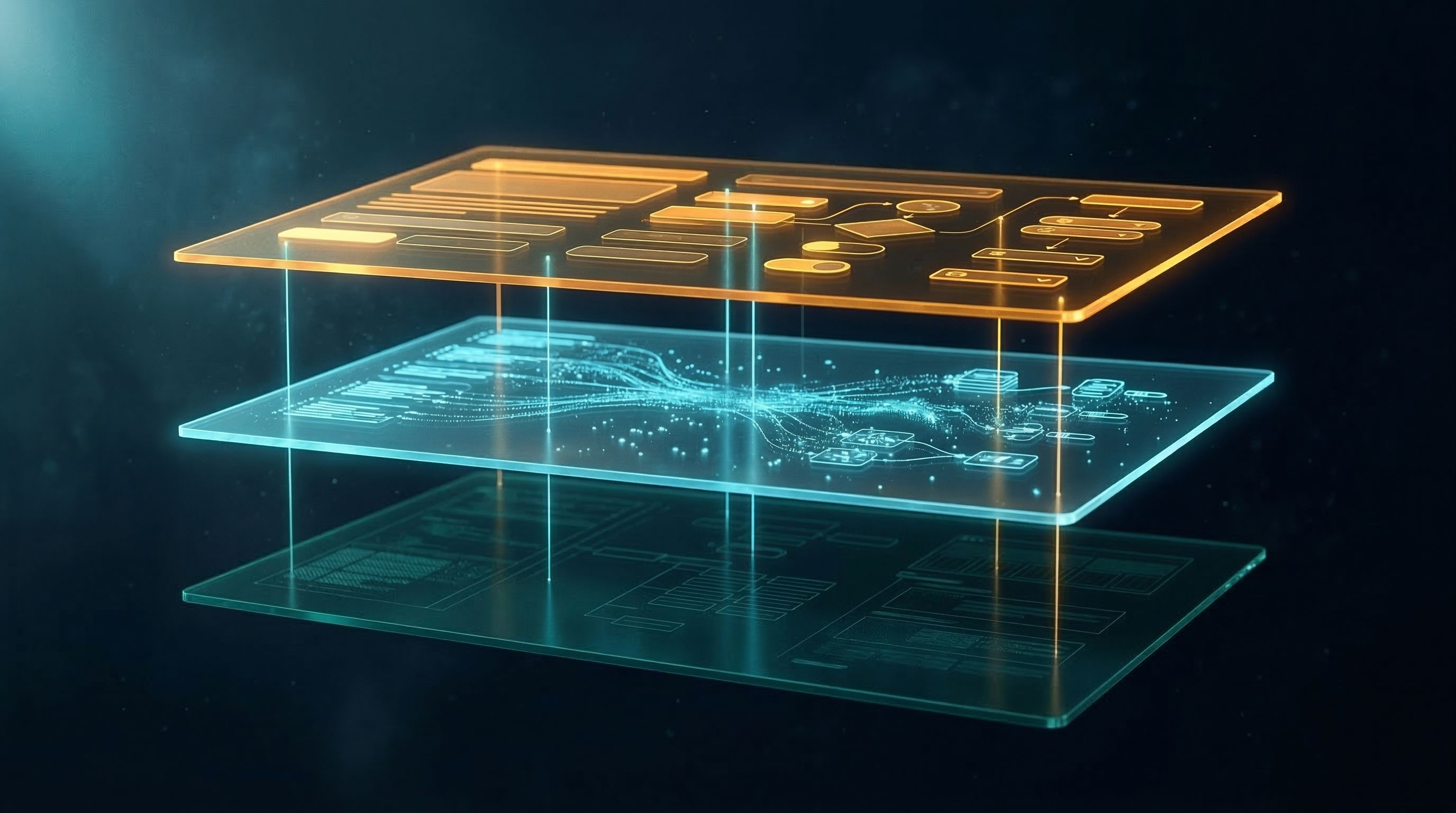

コンピュータビジョン(コンピュータに視覚能力を持たせる技術分野)において、画像を理解する手法は段階的に進化してきました。

画像分類(Image Classification)は、画像全体に1つのラベルを付ける処理です。「これは犬の写真」「これは車の写真」というように、画像の中身をひとことで言い表す。もっとも基本的な画像認識です。

物体検出(Object Detection)は、画像の中のどこに何があるかを特定します。「左上に犬がいる」「右下に車がある」というように、対象物を四角い枠(バウンディングボックス)で囲んで位置を示す。

セマンティックセグメンテーション(Semantic Segmentation)は、さらに一歩進んで、画像内の全ピクセルにカテゴリラベルを割り当てます。「このピクセルは犬」「このピクセルは芝生」「このピクセルは空」というように、画像全体を意味の単位で塗り分ける。

人間にとってはごく自然にやっていること、つまり「目に映る風景を、道路・建物・空・人・車とスムーズに認識する」行為を、機械にもできるようにする技術です。

なお、セマンティックセグメンテーションの発展形としてインスタンスセグメンテーション(同じカテゴリの中で個体を区別する。たとえば「犬A」「犬B」を別々に認識する)や、両者を統合したパノプティックセグメンテーションもありますが、本連載では「ピクセル単位で意味を理解する」というコアコンセプトに焦点を当てます。

なぜ今、この技術が重要なのか

セマンティックセグメンテーションの研究自体は、2014年末に発表されたFully Convolutional Networks(FCN)あたりから本格化し、U-Net、DeepLab、PSPNetといった代表的なモデルが次々と登場してきました。10年以上の歴史を持つ技術です。

では、なぜ2026年の今、改めてこの技術に注目すべきなのか。理由は3つあります。

第一に、精度と速度が「実用レベル」を大きく超えたこと。 前述のとおり、iPhoneのNeural Engineは数ミリ秒でセグメンテーションを完了します。Google Meetはブラウザ内でリアルタイム処理を実現しています。かつて研究論文の中だけにあった技術が、数十億台のデバイスに搭載される日常ツールになりました。

第二に、「テキストで指示できる」時代に入ったこと。 2025年11月にMetaがリリースしたSAM 3(Segment Anything Model 3)は、画像をクリックする代わりに「赤い帽子」とテキストで指示するだけで、画像内の該当箇所をすべて検出・分離できます。これはAIエージェントが「言葉で視覚を操れる」ようになったことを意味し、セマンティックセグメンテーションの活用範囲を爆発的に広げました。(第2回で詳しく解説します。)

第三に、AIエージェント時代の「目」になること。 AIエージェントが物理世界やデジタル世界で自律的にタスクを遂行するには、世界を「意味で理解する」能力が不可欠です。セマンティックセグメンテーションは、エージェントに「見る力」を与える基盤技術です。そしてこの「意味で分節する」という発想は、画像だけでなくWebサイトの構造にも広がりつつあります。(第3回・第4回で詳しく解説します。)

ビジネスの現場ではどう使われているか

では、セマンティックセグメンテーションは具体的にどのようなビジネスシーンで活用されているのでしょうか。ビデオ会議やスマートフォンカメラ以外にも、すでに幅広い産業で実用化が進んでいます。

EC・小売

ECサイトの商品画像を思い浮かべてください。多くの場合、商品は白い背景に切り抜かれた状態で掲載されています。従来、この作業はPhotoshopなどで手動で行われていましたが、セマンティックセグメンテーションを使えば、商品と背景を自動で分離し、瞬時に切り抜き画像を生成できます。大量のSKU(商品種類)を扱うEC事業者にとって、画像処理コストの削減は直接的なコスト効果があります。

自動車・自動運転

自動運転車のカメラは、道路・歩道・車線・歩行者・他の車両・信号・標識を、すべてピクセル単位で認識する必要があります。セマンティックセグメンテーションは、自動運転のもっとも基盤的な「知覚」レイヤーを担っています。

医療

MRIやCT画像から腫瘍や臓器の領域をピクセル単位で特定することは、診断精度の向上に直結します。セマンティックセグメンテーションは、放射線科医の診断支援ツールとしてすでに実用化されています。たとえば、CNNとSwin Transformer V2を組み合わせたハイブリッドモデル「FCB-SwinV2 Transformer」(Fitzgerald et al., 2023)は、大腸ポリープのセグメンテーションにおいて94.5%のDiceスコアを達成しています。

Webアクセシビリティ

画像の中に何が写っているかを認識し、Altテキスト(代替テキスト)を自動生成する用途も広がっています。セマンティックセグメンテーションで画像内の要素を分析し、その結果を言語モデルに渡すことで、「ビーチで犬と遊ぶ子供」のような説明文を自動で付与できます。アクセシビリティ対応の効率化につながる、Web制作者にとって身近な応用です。

農業・環境モニタリング

衛星画像やドローン画像から農地の作物状態を分析し、病害虫の発生や灌漑の必要性を判定するのにもセマンティックセグメンテーションが使われています。都市計画や環境保全の分野でも、土地利用の変化を追跡するための基盤技術として活用されています。

まとめ ― 「意味で分ける」ことの本質

セマンティックセグメンテーションの本質は、「世界を意味の単位で分節する」ということです。

画像のピクセルを「色が似ているから同じグループ」ではなく、「これは人間の手、これは背景の壁」と、意味に基づいて分類する。人間が無意識にやっている「見て、理解する」という行為を、機械にも可能にする技術です。

この技術は、すでにあなたのスマートフォンの中で、ビデオ会議アプリの中で、ECサイトの裏側で、日常的に稼働しています。しかし、2025年から2026年にかけて、この技術は次の段階に入りました。

次回の第2回では、Metaが2025年11月にリリースしたSAM 3(Segment Anything Model 3)を取り上げます。「言葉で指示するだけで、画像内のあらゆるものを検出・分離できる」この革命的なモデルが、なぜAIエージェント時代の基盤技術になるのか。その構造と可能性を解説します。

参考情報

Google Research「Background Features in Google Meet, Powered by Web ML」

Google Research「High-Definition Segmentation in Google Meet」

Apple WWDC19「Advances in Camera Capture & Photo Segmentation」

Apple WWDC19「Introducing Photo Segmentation Mattes」

Apple Machine Learning Research「A Multi-Task Neural Architecture for On-Device Scene Analysis」(2022年)

Apple Machine Learning Research「On-device Panoptic Segmentation for Camera Using Transformers」

Apple Machine Learning Research「Fast Class-Agnostic Salient Object Segmentation」

Long, Shelhamer & Darrell「Fully Convolutional Networks for Semantic Segmentation」(arXiv, 2014年)

Meta AI「Introducing Meta Segment Anything Model 3」(2025年11月)

Springer Nature「Advancement in semantic segmentation techniques: a comprehensive review for semantic segmentation of colorectal polyps using deep learning」(2025年)

この記事は「AIエージェント時代の『セマンティックセグメンテーション』」シリーズの第1回です。

第2回:SAM 3 ― 「言葉で指示するだけ」の革命 | 第3回:AIエージェントが「見て」「動く」ためのWebセマンティクス(近日公開) | 第4回:「意味の分節化」が交差する未来(近日公開)

AI技術のビジネス活用やWebサイトのAIエージェント対応について、具体的なご相談はunTypeまでお気軽にお問い合わせください。

この記事をシェアする